Alles auf einen Blick

Content from Vorbesprechung

Zuletzt aktualisiert am 2026-05-12 | Diese Seite bearbeiten

Geschätzte Zeit: 12 Minuten

Übersicht

Fragen

- Was ist Datenmanagement?

- Was ist digitale Selbstbestimmtheit?

- Warum ist eine selbst gehostete Datenmanagementlösung gut?

Ziele

- Thematische Einleitung

- Vorstellung der Ziele und Inhalte des Kurses

- Voraussetzungen, die Sie mitbringen sollten

- Informationen zum Ablauf des Kurses

Thematische Einleitung

Datenmanagement im wissenschaftlichen Kontext

Der Begriff des Forschungsdatenmanagements (FDM) umschreibt den Umgang mit Forschungsdaten (z.B. Messdaten, Bilder, Artikel, Interviewdaten u.v.m.) innerhalb von Forschungsprojekten. Dabei beginnt FDM bei der Planung von Projekten, legt Standards für das Erstellen, Analysieren und Publizieren fest und sorgt durch strukturierte Archivierung für eine nachhaltige Speicherung und die Möglichkeit der Nachnutzung der Forschungsdaten.

Mehr zum Thema FDM finden Sie z.B. hier, hier oder im Kurs FDM Basics

Um während der aktiven Forschungsarbeit seine Daten strukturiert und zugänglich speichern zu können und mit anderen Projektteilnehmenden kollaborieren zu können, sind online Dateispeicherung und online Dateibearbeitung essentiell.

Häufig werden hierfür die Angebote großer Tech-Konzerne aus dem Ausland genutzt. Es gibt aber auch die Möglichkeit solche Lösungen selbst zu betreiben. Dadurch ist der Datenschutz gewährleistet, da keine Daten außerhalb der EU gespeichert werden. Außerdem ist man unabhängig von den vermeintlich günstigen Angeboten der Tech-Konzerne.

Die Probleme, die eine solche Abhängigkeit auch im privaten Alltag herbeiführen, erfahren Sie in der folgenden Aufgabe.

Aufgabe 1: Mark und sein Sohn

Lesen Sie den folgenden Artikel: SPIEGEL: Autoupload in die Google-Cloud

Welche grundlegenden Probleme führten zu Marks Situation?

In diesem Fall ist einiges schief gelaufen. Wir werden darüber in der ersten Präsenzsitzung diskutieren.

Auf jeden Fall hat Mark jedoch seine informationelle Selbstbestimmung aufgegeben.

Informationelle Selbstbestimmtheit

Unter dem Begriff informationelle Selbstbestimmtheit wird verstanden, dass Personen selbst über ihre Daten bestimmen können. Das Bundesverfassungsgericht hat dazu bereits 1983 geurteilt:

“Das Grundrecht gewährleistet insoweit die Befugnis des Einzelnen, grundsätzlich selbst über die Preisgabe und Verwendung seiner persönlichen Daten zu bestimmen.”

Aber wie können wir selbst über die Preisgabe unserer Daten bestimmen?

Digitale Mündigkeit

Um selbst über seine Daten zu bestimmen, sollte man die Daten und deren Zustandenkommen verstehen. D.h. angewendete Technik sollte verstanden und hinterfragt werden. Stimmt etwas nicht, sollte Kritik geübt werden oder ggf. nach Alternativen gesucht werden. Fragen Sie sich beim Einsatz digitaler Tools immer:

Welche Daten gibt es?

Wann entstehen welche Daten?

Wer hat Zugriff auf diese Daten?

Welche Daten möchte ich wem preis geben und welche behalte ich für mich?

Wie digital mündig sind Sie?

Lesen Sie den folgenden Artikel von Digitalcourage

Welche der im Artikel genannten Punkte setzen Sie bereits um? In welchen Bereichen können Sie noch “mündiger” werden?

Nutzen Sie ein kostenloses E-Mailpostfach? Speichern Sie Daten in verdächtig günstigen Onlinespeichern? Wie abhängig sind Sie von Big Tech (Apple, Google, Amazon, Microsoft)?

Mehr zum Thema digitale Mündigkeit findet sich auch bei Simon 2024 1

Digitale Selbstbestimmtheit

Zu einem selbstbestimmten Leben gehört auch eine digitale Selbstbestimmtheit.

Deshalb:

eingesetzte Technik verstehen

Open-Source statt Closed Source

Community statt Großkonzern

Noch mehr zu digitaler Selbstbestimmtheit und Selbstverteidigung

Noch mehr Informationen zum Thema finden Sie bei Interesse unter anderem bei den folgenden Quellen:

E. Snowden, Permanent Record - Meine Geschichte, (Berlin 2019)

J. Caspar, Wir Datensklaven - Wege aus der digitalen Ausbeutung, (Berlin 2023)

Ziele und Inhalte des Kurses

Allgemeine Ziele

Einstieg die Linux-(Server)-Welt

Weniger Angst vor Technik (und Fehlern)

Einstieg in die Systemadministration

Einrichten einer selbst betriebenen Webanwendung zur Dateiverwaltung (“Cloud”) mittels Docker

Inhaltliche Schwerpunkte

- Betriebssystem: Installation und grundlegende Verwaltung:

Wir beginnen ganz am Anfang mit der Installation und dem Kennenlernen des Linux-Betriebssystems. Wir nutzen dazu das Betriebssystem Ubuntu in der Servervariante, welches wiederum auf dem Debian-Betriebssystem aufbaut.

- Sicherheit: Backup, Firewall, Fern-Zugriff:

Vor der Installation der eigentlichen Cloud-Software muss der Server eingerichtet werden. Dazu zählen z.B. Funktionen zum Fernzugriff (SSH), verschiedene Techniken zum Absichern des Servers (Firewall, Benutzer und Zugriffsrechte) aber auch das Thema Backup.

- Docker und Webserver

Im zweiten Teil des Kurses liegt der Fokus auf Webservern, mit welchen Webanwendungen verfügbar gemacht werden und Docker, mit welchem Software unabhängig vom Betriebssystem installiert und konfiguriert werden kann. Als Webserver werden wir mit Apache2 und NGINX arbeiten und lernen, wie wir TLS-Zertifiakte zur Sicherung der Webanwendung erhalten.

- Nextcloud und mehr Services

Im dritten Teil des Kurses werden die zuvor erlernten Grundlagen angewendet, um mit Docker die Kollaborationsplattform Nextcloud und andere spannende Webanwendungen zu installieren und zu konfigurieren.

Voraussetzungen

Allgemeine Voraussetzungen

Sie sollten sicher mit Ihrem PC (Windows oder Linux) oder Ihrem Mac umgehen können

Sie sollten keine Angst vor Technik und der Kommandozeile haben

Sie benötigen ein Notebook oder Tablett mit Tastatur (keine Touch-Geräte).

Zugriff mit Ihrem Gerät auf das Eduroam- und das VPN-Netzwerk der Universität Tübingen

Technische Voraussetzungen

Allen Teilnehmenden wird ein virtueller Server im Rechenzentrum der Universität zur Verfügung gestellt. Sie benötigen keinen eigenen Server. Sollten Sie die im Kurs erlangten Kenntnisse später auf eigener Hardware umsetzen wollen, eignen sich Einplatinen-Computer (System-on-Chip, kurz SoC) wie ein Raspberry Pi 5.

Organisatorisches

Wöchentlicher Ablauf:

Die Wochen laufen i.d.R. wie folgt ab:

- Sie arbeiten das Selbstlernmaterial auf Github durch

Sie setzen die Arbeitsschritte selbstständig auf Ihrem Server um. Dazu können Sie zum Übungstermin kommen.

Sie kommen am Ende jeder Studieneinheit (3x pro Semester) zu einem Vertiefungsgespräch

Leistungsnachweis

Bei erbrachter Leistung erhalten Sie für diesen Kurs 3 ECTS-Punkte

Der Kurs ist anrechenbar für das Zertifikat Data Literacy im Wahlbereich praktische Anwendungen

-

Die erforderlichen Leistungen sind:

wöchentliche Bearbeitung der Lernmaterialien

selbstständige Konfiguration eines Cloud-Servers

3 Vertiefungsgespräche im Semester

Verfassen eines Abschlussberichts (ca. 3-4 Seiten)

Der Workload beträgt entsprechend 3 ECTS ca. 90 Stunden im Semester. Davon entfallen ca. 21 Stunden auf die Übungen, 9 Stunden auf den Abschlussbericht und 60 Stunden auf die Vor- und Nachbereitung der Sitzungen inkl. den Vertiefungsgesprächen. D.h. pro Woche müssen Sie während der Vorlesungszeit durchschnittlich ca. 4,3 Stunden Arbeitszeit zusätzlich zu den Übungssitzungen einplanen.

Mehr Informationen folgen in der ersten Präsenzsitzung.

- Die eigene Cloud schützt die Privatsphäre und reduziert die Abhängigkeit von großen Monopolisten

- Der Kurs begleitet Sie vom Linux Betriebssystem über die Grundkonfiguration des Servers bis hin zur Installation und Konfiguration des eigenen Cloudservers im Docker Container

- Sie müssen jede Woche Selbstlernmaterial durcharbeiten und die praktischen Aufgaben absolvieren

- Am Ende des Kurses müssen Sie noch einen Abschlussbericht verfassen

- Für den Kurs erhalten Sie 3 ECTS-Punkte

L. Simon, Digitale Mündigkeit - Wie wir mit einer neuen Haltung die Welt retten können, (Bielefeld 2024)↩︎

Content from Betriebssystem und Linuxgrundlagen

Zuletzt aktualisiert am 2026-05-12 | Diese Seite bearbeiten

Geschätzte Zeit: 12 Minuten

Übersicht

Fragen

Wie wähle ich die richtige Hard- und Software aus?

Wie installiere ich ein Linux-Betriebssystems?

Wie bediene ich ein Linux-Betriebssystem?

Ziele

- Begriffsklärung

- Betriebssystem installieren

- Grundlagen mit der Linux-Kommandozeile

Die Hard- und Software

Hardware

Zu Beginn der meisten IT-Projekte steht die Frage, wo diese Projekte umgesetzt werden sollen. Dabei gibt es heutzutage unterschiedliche Möglichkeiten. Abgesehen von Tests auf lokalen Endgeräten wie PC oder Notebook, werden für viele Projekte spezialisierte Geräte genutzt. Vor allem für Firmen, Rechenzentren und andere Hochleistungsszenarien werden Computer mit spezialisierter Hardware (Prozessoren, Festplatten, Arbeitsspeicher oder RAID-Controller) eingesetzt, die für diese anspruchsvollen Aufgaben geeignet ist und häufig nicht mit Endanwender-Hardware vergleichbar ist.

Neben eigener Hardware besteht heute auch die Möglichkeit, seine Projekte auf fremder Hardware umzusetzen. Diese fremde Hardware befindet sich in einem entfernten Rechenzentrum (“der Cloud”) und ist über das Internet erreich- und steuerbar. Häufig wird die Hardware dabei virtualisiert, d.h. dass z.B. die Leistung eines echten Prozessors mithilfe von Software für mehrere virtuelle Computer zur Verfügung gestellt wird.

Für dezentrale Projekte können sogenannte Embedded Devices genutzt werden. Hierbei handelt es sich häufig um Spezialanfertigungen für genau einen Einsatzzweck, z.B. als Kassensystem oder Waage im Supermarkt oder als Informationsdisplay im öffentlichen Raum. Für diese Geräte werden auch spezielle Betriebssysteme und Software eingesetzt.

Für kleinere Projekte wie Heimanwender können normale PCs genutzt werden. Passender für Projekte mit wenig Leistungsanspruch (und im Heimanwenderbereich ist das i.d.R. der Fall) sind Mini-PCs, bei denen sämtliche oder die meisten Bauteile (Prozessor, Arbeitsspeicher, Datenspeicher und externe Schnittstellen wie Netzwerk und USB) auf einer Platine verbaut sind. Diese sogenannten Systems-on-a-Chip (SoC) haben den Vorteil, dass sie besonders energiesparsam sind, wenig Platz benötigen, keinen oder kaum Lärm verursachen und im Vergleich mit herkömmlichen PCs oder gar professionellen Servern deutlich günstiger sind.

Server vs. Client

Bezogen auf ihre Funktion innerhalb eines Computernetzwerks werden Geräte unterschiedlich bezeichnet:

- Client

Klassisches Endgerät wie PC, Notebook oder Smartphone. Hat keine zentralen Aufgaben. Ist ein Client-Gerät ausgefallen, ist das Netzwerk nicht betroffen.

- Server

Übernimmt als Kommunikationsknotenpunkt zentrale Aufgaben im Netzwerk. Je nach Leistungsbedarf werden spezialisierte Hochleistungshardware, normale PCs oder SoCs genutzt. Fällt ein Server aus, fehlt damit i.d.R. eine zentrale Funktion im Netzwerk. Je nachdem welche Aufgaben der Server hat, kann dies zum vollständigen versagen des Netzwerks führen oder nur zum Ausfall eines Dienstes (z.B. einer Website).

Software

Unter Software kann all das verstanden werden, was nicht angefasst werden kann. Also sämtlicher Programmcode, der auf einem Computer installiert ist. Dazu gehört sowohl das Betriebssystem, die Boot-Umgebung (welche das Betriebssystem lädt) aber auch alle anderen Programme wie Treiber, eine Firewall, ein Office-Programm oder ein Webserver-Programm.

Möchte man ein bestimmtes IT-Projekt umsetzen und hat die Hardware besorgt, gilt es auch die richtige Software auszuwählen. Hierbei ist zu beachten, dass Hard- und Software miteinander kompatibel sein müssen. Z.B. unterstützt nicht jedes Betriebssystem jede Art von Prozessor (siehe auch diesen Wikipedia-Artikel).

Abhängig von den Programmen, die man nutzen möchte, kann das passende Betriebssystem gewählt werden. Für viele Serveranwendungen, wie die in diesem Kurs genutzte Software Nextcloud, werden Linux-Betriebssysteme empfohlen. In vielen Fällen werden für die Funktion des Hauptprogramms weitere Programme benötigt. Das sind häufig ein Datenbankmanagementsystem wie Mysql oder MariaDB, die Skriptsprache PHP, und ein Webserver wie Apache2. In dieser Kombination spricht man auch von einem LAMP-Stack (Linux, Apache, Mysql/MariaDB und PHP).

Die genauen Anforderungen an die Hard- und Software sind häufig den Handbüchern der Programme zu entnehmen. Allerdings hängt die richtige Wahl auch von der Intensivität der Nutzung, persönlichen Vorlieben oder Vorgaben innerhalb einer Organisation ab.

System requirements

Szenario: Sie wollen für eine kleine Forschungsgruppe (ca. 10 Personen) eine Datenmanagement-Lösung betreiben und als Serversoftware Nextcloud installieren.

Welche Hardware wählen Sie dafür? Schauen Sie sich dafür die System requirements von Nextcloud an und wählen Sie aus einer der folgenden Hardware-Optionen:

Raspberry Pi 4 mit 8GB RAM für ca. 100€ und einer externen 2 TB USB-HDD-Festplatte

Raspberry Pi 5 mit 8GB RAM für ca. 110€ und einer 2 TB SSD-Festplatte

Odroid H4 Ultra mit einer 2 TB SSD-Festplatte

Einen Tower Server Intel RI1104-SMXEH Serie

Die genauen Hardwareanforderungen sind (v.a. am Anfang des Projekts und ohne Vorkenntnisse) schwer abzuschätzen. Geeignete Lösungen können aber die Nummern 2. und 3. sein. Die Nummer 4 wäre überdimensioniert und mit der Nummer 1. kommt das System an seine Grenzen. Auch der Raspberry Pi 5 ist für 10 Personen vermutlich zu schwach. Das hängt aber stark von der Art und der Intensivität der Nutzung ab.

Installation des Betriebssystems

Um ein Betriebssystem neu zu installieren, muss beim Starten des PCs/Servers (egal ob virtualisiert oder als physisches Gerät) ein bootbares Medium mit den Installationsdateien angeschlossen und beim Startvorgang ausgewählt werden.

In diesem Kurs wird mit virtuellen Servern gearbeitet, die mit der Virtualisierungsplattform Proxmox betrieben werden. Beim Start Ihres Servers ist bereits ein Installationsmedium eingebunden und als Startmedium hinterlegt.

Loggen Sie sich in der Proxmox-Webconsole ein und wählen Sie Ihren Server im rechten Menü aus. Gehen Sie nun im vertikalen Menü der virtuellen Maschine in den Bereich Console und klicken Sie im Konsolen-Fenster auf starten. Die virtuelle Maschine startet und der Ubuntu-Installationsassistent leitet durch die Installation des Servers.

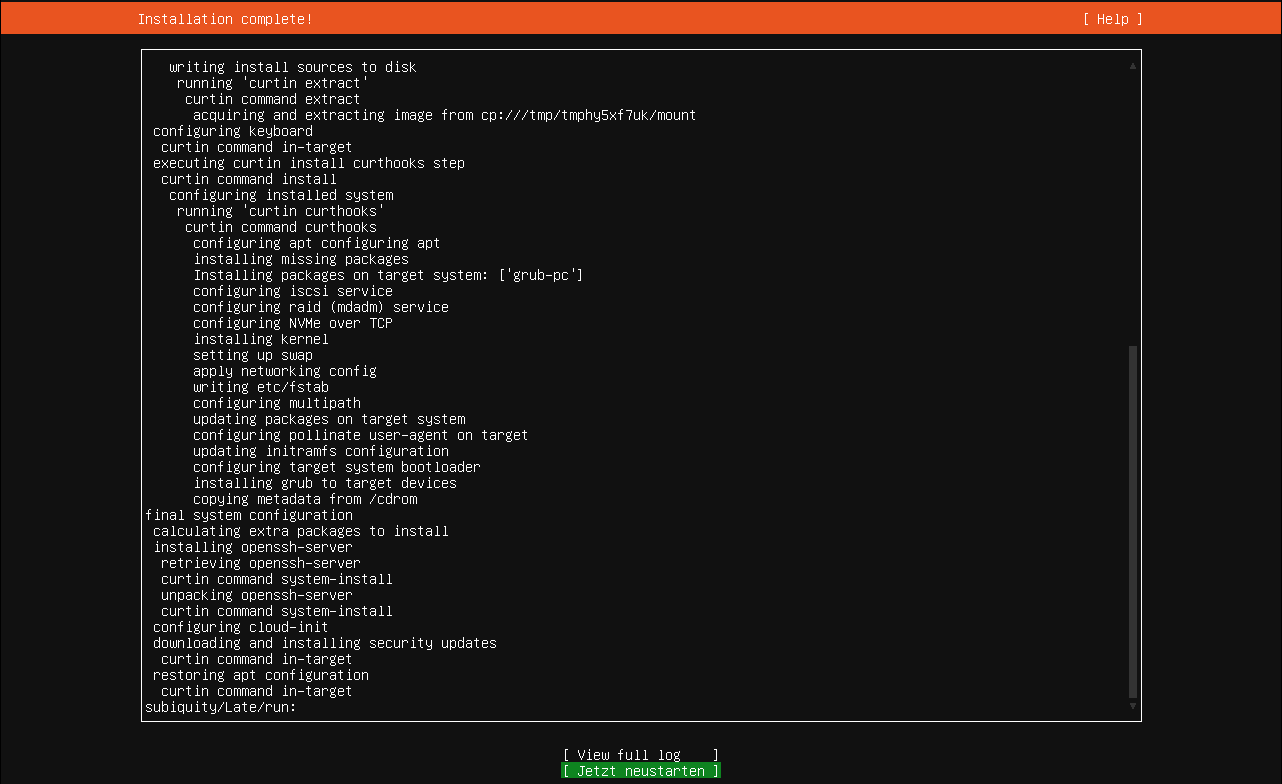

Installationsassistent

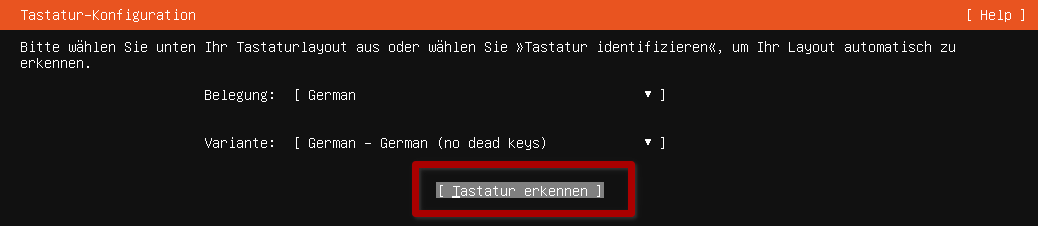

Die meisten Schritte sind selbsterklärend und können für den Einsatz in diesem Kurs auf dem Standardwert belassen werden. Vorsicht ist aber bei der Wahl des richtigen Tatstaturlayouts walten zu lassen. Nutzen Sie am besten die Möglichkeit der Tastaturerkennung.

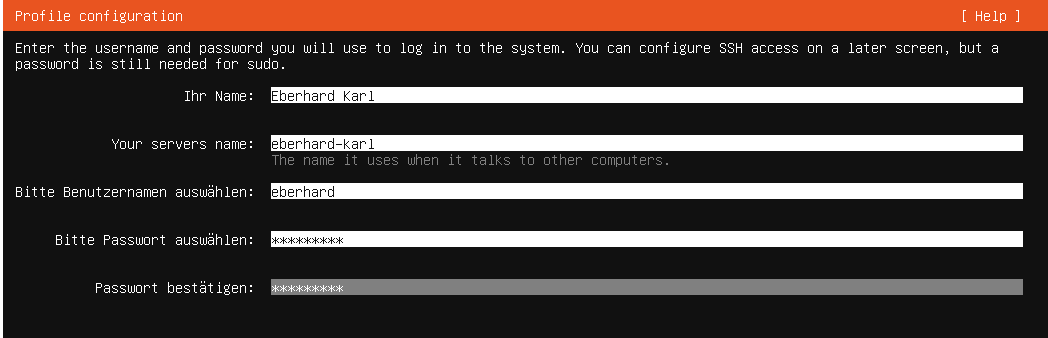

Bei der Erstellung des ersten Benutzerprofils ist auf folgendes zu achten:

Name: Der Name des Benutzers sollte der natürliche Name der Person sein, die das System verwenden wird.

Servername (Hostname): Der Servername, auch Hostname genannt, ist der eindeutige Name des Servers im Netzwerk. Er sollte nur aus Kleinbuchstaben bestehen und keine Leerzeichen enthalten. Der Hostname dient zur Identifikation des Servers und sollte sinnvoll gewählt werden, um Verwechslungen zu vermeiden.

Benutzername: Der Benutzername sollte ebenfalls nur aus Kleinbuchstaben bestehen und keine Leerzeichen enthalten. Dies stellt sicher, dass der Benutzername in allen Systemkomponenten korrekt erkannt und verarbeitet wird.

Passwort: Im Produktivbetrieb sollte das Passwort mindestens 20 Zeichen lang sein. Ein starkes Passwort erhöht die Sicherheit des Systems und schützt vor unbefugtem Zugriff. Es wird empfohlen, eine Kombination aus Groß- und Kleinbuchstaben, Zahlen und Sonderzeichen zu verwenden.

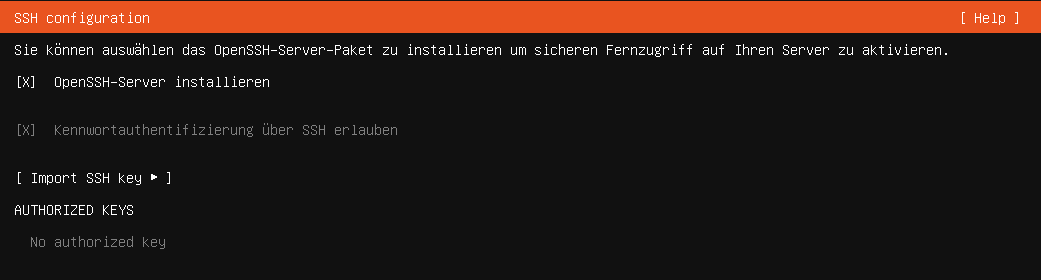

Wählen Sie außerdem die Option, den SSH-Server (Secure Shell) zu installieren. Der SSH-Server ermöglicht einen sicheren Fernzugriff zu Ihrem Server, um ihn zu Administrieren. Mehr dazu folgt in den nächsten Sitzungen.

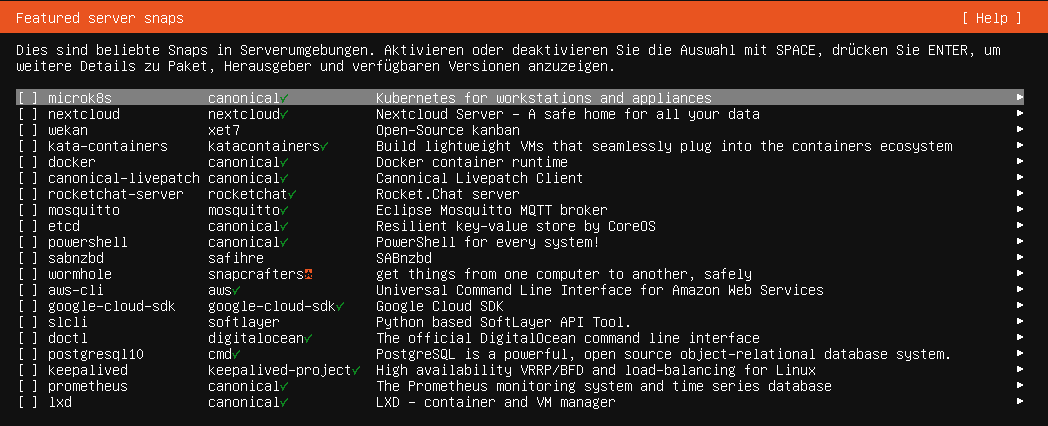

Achten Sie darauf, dass Sie keine Snap-Pakete installieren. Snap-Pakete sind speziell verpackte Programme von Ubuntu, die einfach zu installieren sind und in einer isolierten Umgebung ausgeführt werden. Allerdings bieten Snap-Pakete aufgrund ihrer isolierten Umgebung nicht immer die beste Leistung und sind weniger flexibel als traditionelle Paketverwaltungsmethoden wie apt. Für eine Serverumgebung, in der Leistung und Flexibilität wichtig sind, ist es daher empfehlenswert, auf Snap-Pakete zu verzichten.

Nachdem die Installation abgeschlossen ist, starten Sie den Server neu, um sicherzustellen, dass alle Änderungen übernommen wurden. Anschließend können Sie sich mit den während der Installation erstellten Anmeldeinformationen anmelden.

Linux Grundlagen

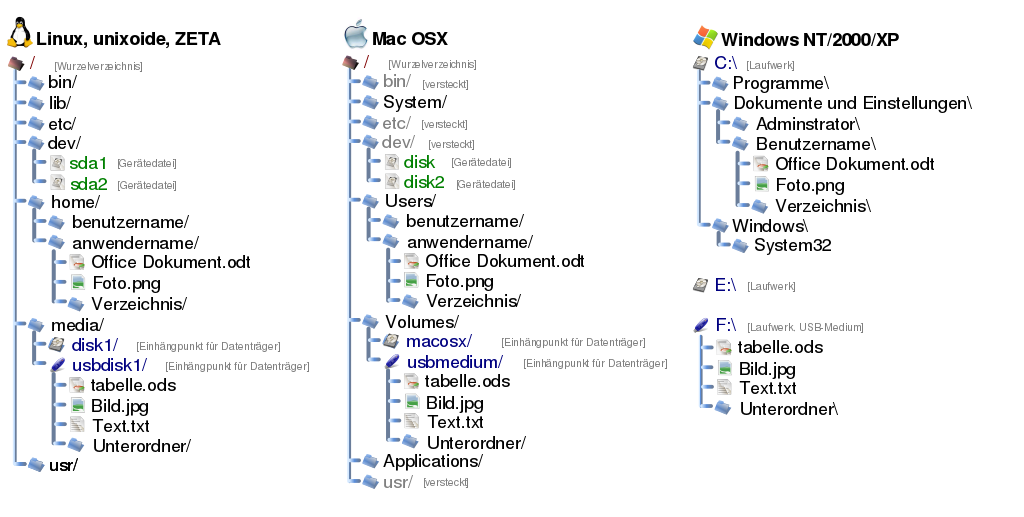

Dateisystem

Das Linux-Dateisystem ist für alle Linux-Distributionen weitestgehend

einheitlich. Die oberste Hierarchie-Ebene ist dabei immer das

Verzeichnis / (Slash). Dieses ist vergleichbar mit der

obersten Hierarchieebene unter Windows, welche in der Regel dem

“C:”-Laufwerk entspricht.

Weitere wichtige Verzeichnisse sind:

- die Benutzerverzeichnisse unter

/home/<username>/, z.B./home/linus/

Hier liegen die Dateien, Dokumente und Konfigurationen der User.

Schreib- und Leserechte haben nur die jeweiligen User und Personen mit

administrativen Rechten. Die Verzeichnisse sind mit dem

Benutzerverzeichnis unter Windows (in der Regel unter

C:\Users\<username>\ zu finden) vergleichbar.

- Die Systemverzeichnisse (z.B.

/etc/,/var/,/mnt/,/lib/,/bin/,/sys/)

Diese Verzeichnisse beinhalten Systemdaten, z.B. Programme, Programmbibliotheken, temporäre Dateien, Log-Dateien oder systemweite Konfigurationen. Deshalb haben in diesen Verzeichnissen i.d.R. nur Personen mit administrativen Rechten Schreibrechte.

Im Vergleich mit dem Dateisystem von Windows fällt auf, dass es unter

Linux nur einen Verzeichnisbaum für alle Dateien, Festplatten und

Laufwerke gibt. Auch zusätzliche Festplatten oder externe Datenträger

werden in Linux-Systemen zunächst durch eine Gerätedatei im Verzeichnis

/dev/ identifiziert und können dann über sogenannte

Einhängepunkte oder Mountpoints an einer beliebigen Stelle des

Verzeichnisbaumes verfügbar gemacht werden (“eingehängt” oder

“gemountet” werden). Unter Windows haben zusätzliche Datenträger und

Laufwerke stets ihre eigene unabhängige Verzeichnishierarchie, was die

Verwaltung von Festplatten weniger flexibel macht.

- Systemweite Konfigurationen in

/etc/

Das Verzeichnis /etc/ enthält zahlreiche

Konfigurationsdateien für die systemweite Verwaltung von Programmen.

Viele Programme haben hier eigene Unterordner (z.B.

/etc/apache2 für die Konfiguration des Apache-Webservers).

Möchte man die Konfiguration eines Programms systemweit ändern, ist das

/etc/ Verzeichnis i.d.R. ein guter Startpunkt.

Schreibrechte haben hier nur Personen mit administrativen Rechten.

-

Programmverzeichnnisse:

/bin/,/sbin/,/usr/bin//usr/sbin//bin/: Essentielle Systemprogramme (Start, Restore, Basisprogramm des Betriebssystems)/usr/bin/: ergänzende Systemprogramme/sbin/und/usr/sbin/: Systemprogramme für die Systemadministration, die i.d.R. nur von Personen mit administrativen Rechten nutzbar sind

Dynamische Programmdateien:

/var/

Das Betriebssystem und darauf installierte Software erzeugt ständig

neue Dateien, z.B. werden in Log-Dateien Systemereignisse protokolliert.

Solche dynamischen Inhalte werden i.d.R. im

/var/-Verzeichnis gespeichert (v.a. im Unterverzeichnis

/var/log).

- Einhängepunkte

/mnt/und/media/

Externe Laufwerke und Wechselmedien werden standardmäßig in den

Verzeichnisse /mnt/ und /media/ eingebunden.

Dies ist allerdings keine zwingende Vorgabe und häufig gibt es gute

Gründe eine Festplatte an einer anderen Stelle des Verzeichnisbaumes

einzuhängen, z.B. im Home-Verzeichnis eines Users.

- Temporäre Dateien:

/tmp/

Das Verzeichnis /tmp/ dient der Speicherung von

temporären Dateien. Viele Anwendungen und Systemprozesse nutzen es, um

ihre Arbeit auszuführen. Die Dateien in /tmp/ werden in der

Regel automatisch gelöscht, wenn der Rechner neu gestartet wird oder

wenn sie nicht mehr benötigt werden.

- Prozesse und Hardware:

/proc/und/sys/

Das Verzeichnis /proc/ enthält Informationen über

laufende Prozesse und Systemhardware. Viele Systemtools lesen

Informationen aus /proc/, um die Systemleistung zu

überwachen. Das Verzeichnis /sys/ enthält Informationen

über Systemhardware und Gerätetreiber. Systemtools und Anwendungen

nutzen /sys/, um Informationen über die Systemhardware zu

erhalten und die Hardware-Konfiguration zu ändern. Mit dem Befehl

cat /proc/cpuinfo erhält man z.B. Informationen zum

verbauten Prozessor oder mit cat /sys/power/state

Informationen zu den unterstützten Standby- und Power-Modi des

Systems.

- Weitere Quellen

Mehr zur Verzeichnisstruktur von Linux findet sich z.B. bei Ubuntuusers.

Softwareverwaltung

Programme (oder auch Pakete, Packages, Software oder Apps) werden in Linux i.d.R. durch eine zentrale Paketverwaltung ähnlich einem App-Store auf dem Smartphone installiert. Da auch Android auf dem Linux-Kernel aufbaut, sind die Prozesse zur Softwareverwaltung in Ubuntu vergleichbar mit den Prozessen, die im Hintergrund ablaufen, wenn man auf dem Smartphone eine App installiert oder aktualisiert.

- Paketquellen

Zur Installation verfügbare Software wird unter Linux in Paketrepositorien (oder auch Paketkatalog oder Paketquelle) aufgelistet und verfügbar gemacht. Ein Repositorium wird i.d.R. vom Hersteller des Betriebssystems zur Verfügung gestellt und ähnelt in der Funktion dem Google-Play-Store auf einem Android-Smartphone.

Die in den Repositorien des OS-Herstellers beinhaltete Software ist kompatibel mit dem Betriebssystem und, je nach konkretem “Unterkatalog”, auch getestet. Allerdings handelt es sich nicht immer um die neueste Version eines Programms. Denn neue Versionen werden aufgrund der Tests und Abhängigkeiten zu anderer Software erst zeitverzögert in die Kataloge aufgenommen.

Mehr Informationen zur Funktionalität der Paketquellen findet sich bei Ubuntuusers.

Bevor Software Software installiert werden kann, muss das

Betriebssystem die aktuelle Version des Katalogs herunterladen. Dies

erfolgt auf der Kommandozeile mit dem Befehl

sudo apt-get update oder sudo apt update.

Möchte man anschließend ein Programm installieren, muss der Name des

entsprechenden Pakets bekannt sein. Die Installation erfolgt mit

sudo apt-get install <Paketname>.

Der Vorteil der zentralen Paketverwaltung ist, dass in den

Repositorien stets festgehalten ist, welche Version eines Programms die

aktuelle ist. Durch den Abgleich der Versionen aller installierter

Programme mit dem Repositorium kann die Paketverwaltung schnell

ermitteln, für welche Programme es Aktualisierungen gibt. Um diese zu

installieren, muss der Befehl sudo apt-get upgrade

ausgeführt werden.

- Fremdquellen

Ist in den Paketquellen des OS-Herstellers nicht die nötige Software enthalten, können auch Fremdquellen zum System hinzugefügt werden. Hierbei handelt es sich um Paketkataloge, die nicht vom OS-Hersteller (oder der Community) überprüft wurden. Deshalb besteht hier stets die Gefahr, dass die enthaltende Software das System beschädigt oder es sich um Schadsoftware handelt. Es gibt jedoch immer wieder Fälle, bei welchen solche Fremdquellen nötig sind. Wie diese dem System hinzugefügt werden können, ist z.B. hier geschildert.

- Weitere Befehle wichtige Befehle für die Paketverwaltung

sudo apt-get autoremove: entfernt Abhängigkeiten von Programmen, die selbst nicht mehr installiert sind. Dadurch wird das System aufgeräumt.sudo apt list --upgradeable: zeigt installierte Programme an, für welche Aktualisierungen verfügbar sindsudo apt-get remove <Paketname>: entfernt ein Paket, nicht jedoch dessen Konfigurationsdateiensudo apt-get purge <Paketname>: entfernt ein Paket inkl. dessen Konfigurationsdateien

- Stolpersteine bei der Paketverwaltung

Abhängigkeitsprobleme: v.a. bei der manuellen Installation von Paketen oder der Nutzung von Fremdquellen besteht die Möglichkeit, dass ein Programm ein anderes Programm als Abhängigkeit benötigt. Diese Abhängigkeit ist aber nicht in den Paketquellen enthalten. Dadurch kommt es zu einem nicht automatisch auflösbaren Abhängigkeitsproblem. Mögliche Maßnahmen sind die manuelle Installation der Abhängigkeiten (die aber weitere Abhängigkeiten haben können) oder der Downgrade auf eine kompatible Version.

Paketname: häufig sind die Paketnamen für ein Programm nicht eindeutig. Um den genauen Namen für die Installation zu finden, können die Programmkataloge durchsucht werden:

sudo apt-cache search <Suchbegriff>. Alternativ kann natürlich auch im Internet nach dem genauen Namen eines Pakets gesucht werden.

Webserver

Sie möchten auf Ihrem Linux-Server eine Website betreiben. Dazu wollen Sie den Webserver Apache installieren. Wie gehen Sie vor?

Der erste Schritt bei der Softwareverwaltung sollte immer die

Aktualisierung der Paketquellen sein:

sudo apt-get update.

Anschließend wird das System auf den aktuellen Stand gebracht:

sudo apt-get upgrade.

Nun müssen Sie herausfinden, wie das Paket, das den Apache-Webserver

für Ubuntu liefert, heißt. Das können Sie mit einer Internetrecherche

oder dem Befehl sudo apt-cache search apache tun.

Wenn Sie wissen, wie das Paket lautet, können Sie dieses mit dem

Befehl sudo apt-get install <Paketname>

installieren.

Kommandozeile

-

Grundlegende Bedienung:

ENTER-Taste nach Eingabe eines Befehls wird dieser mit der ENTER-Taste ausgeführt

Pfeiltasten hoch/runter: durch bisherige Befehle blättern und diese wieder aufrufen

Tab-Taste: Autovervollständigung von Pfaden und Befehlen. Erste Buchstaben eines Pfades tippen, dann TAB-Taste für die Autovervollständigung oder anzeigen von Optionen.

STRG + C: bricht den laufenden Befehl ab

Kopieren: mit dem Cursor Text auswählen, dann STRG + Umschalt + C

Einfügen: STRG + Umschalt + V

Cursor-Position: mit Pfeiltasten ändern, geht nicht per Mausklick

-

Mit der Kommandozeile im Dateisystem navigieren:

Verzeichnis wechseln:

cd <Pfadangabe>, z.B.cd /home/david/Dokumentein das eigene Home-Verzeichnis wechseln:

cdEine Ordnerebene nach oben gehen:

cd ..Zwei Ordnerebenen nach oben gehen:

cd ../..Aktuelle Position im Dateisystem anzeigen:

pwdVerzeichnisinhalt anzeigen lassen:

lsoder mit mehr Informationenls -l

-

Dateioperationen:

Datei erstellen:

touch <Dateipfad>/<Dateiname>Verzeichnis anlegen:

mkdir <Dateipfad>/<Neuer-Ordner>Inhalt einer Textdatei ausgeben:

cat <Dateiname>Oberste oder letzte 10 Zeilen einer Datei anzeigen lassen:

head <Dateiname>odertail <Dateiname>-

Datei kopieren/verschieben/löschen:

Copy:

cp <Quelldatei> <Zieldatei>Move:

mv <Quelldatei> <Zeildatei>remove:

rm <Dateiname>oder remove recursive:rm -r <Verzeichnispfad>

Textdateien bearbeiten: Nano-Editor:

Es gibt viele Texteditoren für Linux. Weit verbreitet sind z.B. nano und vim, wobei nano der einsteigerfreundlichere Editor ist. Deshalb arbeiten wir im Kurs mit dem nano-Editor. Wer dennoch mit dem Vim-Editor arbeiten möchte, kann sich z.B. dieses Tutorial anschauen

Datei im Nano-Editor öffnen:

nano <Dateipfad>/<Dateiname>Die Navigation erfolgt ohne Maus, nur mit den Pfeiltasten!

Datei schließen und speichern: STRG + X, dann J, dann ENTER

Schließen ohne zu speichern: STRG + X, dann N

Komplette Zeile löschen: STRG + K

Kopieren und einfügen erfolgt wie auf dem Terminal

Text suchen: STRG + W, dann Suchbegriff eingeben oder für weitere Treffer direkt mit ENTER bestätigen

Zu bestimmter Zeile springen: STRG + /, dann Zeilennummer eingeben

- Die Wahl der richtigen Hard- und Software erfolgt ganz am Anfang und muss auf den Einsatzzweck abgestimmt sein und untereinander komptibel sein.

- In diesem Kurs wird auf einem virtuellen Server mit Linux-Betriebssystem die Cloud-Software Nextcloud als Docker-Container installiert.

- Das Dateisystem unter Linux hat nur einen Verzeichnisbaum, unter welchem alle Festplatten eingebunden sind

- Software wird unter Linux in einer zentralen Paketverwaltung organisiert

- Linux-Server-Systeme werden mit der Kommandozeile verwaltet

Content from Remote Access: das SSH-Protokoll

Zuletzt aktualisiert am 2026-05-12 | Diese Seite bearbeiten

Geschätzte Zeit: 90 Minuten

Übersicht

Fragen

Wie kann ein Computer (ggf. aus der Ferne) verwaltet werden, auch wenn er keinen Bildschirm hat?

Wie kann eine SSH-Verbindung sicher über unsichere Netzwerke hergestellt werden?

Ziele

Grundlagen des SSH-Protokolls verstehen

SSH-Server sicher konfigurieren

Sichere SSH-Verbindungen mit Schlüssel-Authentifikation aufbauen

den Raspberry Pi im Headless-Setup aus der Ferne steuern

Das SSH-Protokoll

Server stehen häufig an unzugänglichen Orten (Keller, gekühlte Serverräume, weit entfernte Rechenzentren o.Ä.). Dennoch müssen sie verwaltet werden. Dies wird heutzutage mittels des SSH-Protokolls gemacht (früher wurde das inzwischen veraltete Telnet-Protokoll genutzt).

Das SSH-Protokoll baut eine sichere Verbindung zwischen einem Clientgerät (z.B. Ihrem Notebook) und einem Server (z.B. Ihrem Raspberry Pi) über ein (ggf. auch unsicheres) Netzwerk auf. Über diese Verbindung besteht in der Regel Zugriff auf die Kommandozeile des entfernten Geräts, womit dieses verwaltet werden kann.

Die Verbindung kann aber auch zum Übertragen anderer Daten genutzt

werden. So können Dateien übertragen werden (mit dem scp-Befehl),

entfernte Dateisysteme lokal genutzt werden (per SSHFS, siehe Wikipedia) oder die

graphische Ausgabe eines entfernten Programms lokal dargestellt werden

(siehe

diesen Heise-Artikel).

Protokoll

Bei einem Protokoll handelt es sich um eine Sammlung genau festgelegter technischer Parameter für den Kommunikationsaustausch zwischen Computern. Ähnlich der Sprache und ihrer Grammatik, auf die sich zwei Menschen zum Kommunizieren einigen. Ein Protokoll hat einen genauen Einsatzzweck und eine klar definierte Funktionsweise. z.B. ist das HTTPS-Protokoll dafür gemacht, Daten zwischen einem Browser und einem Webserver verschlüsselt mittels der TLS-Verschlüsselung zu übertragen. Mehr zum Thema findet sich bei StudySmarter

Das SSH-Protkoll nutzt mehrere etablierte Verfahren der Kryptographie und Netzwerkkommunikation zur Gewährleistung der sicheren Übertragung. Ähnlich einer HTTPS-Verbindung werden beim Verbindungsaufbau zunächst die Kommunikationsstandards zwischen Client und Server ausgehandelt, dann werden Session-Keys zur Verschlüsselung ausgetauscht, welche jedoch nur für die aktuelle Verbindung Gültigkeit haben. Mit diesen Session-Keys wird die eigentliche Verbindung in Form einer symmetrischen Verschlüsselung aufgebaut (welche deutlich schneller ist, als die zuvor stattfindende asymmetrische Verschlüsselung, siehe dazu auch die Ressourcen von Studyflix zur symmetrischen und asymmetrischen Verschlüsselung).

Mehr zur Funktionsweise des SSH-Protkolls können Sie im Netz finden, z.B. bei IP-Insider.

Voraussetzung für die SSH-Verbindung

Sie haben wie in Sitzung 2 besprochen auf Ihrem Server Ubuntu installiert. Nun wollen Sie eine SSH-Verbindung von Ihrem Notebook mit Ihrem Server herstellen. Was sind die Bedingungen für eine erfolgreiche SSH-Verbindung?

Netzwerkverbindung: der Server muss im Netzwerk erreichbar sein. Dazu müssen entweder Server und Client im selben Netzwerk (z.B. demselben Heimnetzwerk) sein oder der Server muss im Internet erreichbar sein.

Software: Auf dem Server muss die SSH-Server-Software installiert sein (das Paket openssh-server) und auf dem Client ein SSH-Client-Programm (das OpenSSH-Client-Programm für die Kommandozeile ist i.d.R. auf allen PCs installiert. Für Windows kann auch das graphische Programm Putty installiert werden).

Berechtigungen: die Anmeldung am entfernten Server ist nur möglich, wenn Sie die Berechtigungen dazu haben. Sie benötigen also einen Account unter Ubuntu und dessen Passwort.

Firewall: eine Firewall am Server oder auf dem Weg dorthin muss die SSH-Verbindung zulassen

Identifizierung: der Server muss für eine ordentliche Verbindung eindeutig identifizierbar sein. Dies geschieht durch sogenannte Host-Keys, die bei der erstmaligen Verbindung vom Server zum Client übertragen werden und manuell akzeptiert werden müssen. Ändert sich der Host-Key (z.B. nach einer Neuinstallation oder weil ein bösartiger Akteur sich als Ihr Server ausgibt) und passt nicht mehr zum ursprünglich übertragenen Key, schlägt die Verbindung fehl. Erst wenn der neue Key akzeptiert wird ist eine Verbindung wieder möglich (gespeicherte Keys finden Sie in der Datei know_hosts.conf im Verzeichnis .ssh in Ihrem persönlichen Ordner).

Grundlegender Verbindungsaufbau

Wenn die Voraussetzungen stimmen (siehe Vorraussetzungen für

die SSH-Verbindung), kann eine einfache SSH-Verbindung mit folgendem

Befehl aufgebaut werden: ssh <user>@<server>

Dabei ist <user> der Username am entfernten Gerät und

<server> ist die Adresse des Servers. Die Adresse

kann entweder in Form einer IP-Adresse (z.B. 192.168.178.10), als URL

(z.B. mein-cloudserver.domain.de) oder als Hostname (z.B.

mein-cloudserver) angegeben werden. Die Variante mit dem Hostnamen

funktioniert jedoch nur, wenn dieser im lokalen Netzwerk bekannt ist

(z.B. in einem Heimnetzwerk im Router angezeigt wird).

Beim erstmaligen Verbindungsaufbau mit einem Server,

muss dessen Host-Key akzeptiert werden. Mit dem Host-Key authentisiert

(d.h. weist sich aus) sich der Server gegenüber dem Client. Durch die

Überprüfung des Host-Keys kann festgestellt werden, ob der Server, mit

dem eine Verbindung aufgebaut werden soll, auch der korrekte Server ist

und nicht etwa die eigene SSH-Anfrage von schädlichen Akteuren umgelenkt

wurde. Diese Überprüfung erfolgt durch den Abgleich des Fingerabdrucks

des Host-Keys. Dazu muss Serverseitig der Befehl

ssh-genkey -lf /etc/ssh/<key.pub> (dabei den Namen

des zu überprüfenden Schlüssels angeben).

Wird ein Host-Key akzeptiert, speichert der openSSH-Client diesen Key in der Datei “known_hosts.conf” im Verzeichnis .ssh ab. Ändert sich der Key des Servers, muss der neue Key akzeptiert werden (vgl. auch Vorraussetzungen für die SSH-Verbindung).

SSH-Verbindung

-

So bauen Sie eine einfache SSH-Verbindung auf:

ssh <user>@<server>- dabei ggf. die besonderen Bedingungen im Kurssetup beachten

Schlüsselauthentifikation

Die einfache SSH-Verbindung genügt zwar schon, um das entfernte System zu verwalten. Allerdings kann eine angreifende Person versuchen, den Usernamen und das Passwort zu erraten und damit Zugriff auf den Server erlangen (leider sind Passwörter häufig nicht allzu kreativ erdacht). Um dies zu verhindern, kann die Verbindung zusätzlich gesichert werden:

am Client, indem statt Passwörtern kaum zu erratende Schlüsselpaare zur Anmeldung genutzt werden

am Server, indem die Einstellungen des SSH-Servers optimiert werden, z.B. um bei häufigen Fehlanmeldungen Verursacher derselben zu blockieren

Die Anmeldung per Schlüssel erfolgt mit einem Schlüsselpaar. Ein solches Schlüsselpaar besteht aus einem privaten und einem öffentlichen Schlüssel. Während der öffentliche Schlüsse herausgegeben werden kann, muss der private Schlüssel privat bleiben und darf das eigene Gerät niemals verlassen. Vereinfacht kann man sich das Konzept wie ein Vorhängeschloss und den dazugehörigen Schlüssel vorstellen. Das Schloss ist in dieser Analogie der öffentliche Schlüssel und wird in geöffnetem Zustand an den Server übergeben. Dieser “verschließt” damit die Tür zum SSH-Server. Zwar können alle sehen, dass Ihr (öffentliches) Schloss an der Tür hängt, aber nur Sie können mit Ihrem privaten Schlüssel die Tür wieder öffnen.

Aufgrund der komplexen kryptographischen Struktur der Schlüssel sind diese deutlich schwerer bis gar nicht zu erraten. Zusätzlich empfiehlt es sich, den privaten Schlüssel mit einer Passphrase vor unbefugtem Zugriff zu schützen. Dann muss jedes mal, wenn der private Schlüssel genutzt wird, ein zusätzliches Passwort eingegeben werden.

Schlüsselauthentifikation

Für eine sichere SSH-Verbindung empfiehlt es sich, auf Passwörter zu verzichten und sich stattdessen mit einem Schlüsselpaar zu authentifizieren.

Ist ein Schlüsselpaar erzeugt, erfolgt die Verbindung wie folgt:

ssh <user>@<server> -i <Pfad-zum-privaten-schlüssel>.

Mit dem Befehlsparameter -i wird der Pfad zum privaten

Schlüssel am Client angegeben (Achtung: für die Kursumgebung die besonderen Bedingungen im Kurssetup

beachten).

Mehr zur Schlüsselauthenfikation finden Sie z.B. bei ManageEngine (hier v.a. die ersten drei Absätze).

Schlüsselpaar erstellen

Die Erstellung eines Schlüsselpaars erfolgt am Client. Dazu wird auf

der Kommandozeile (“Eingabeaufforderung” unter Windows) folgender Befehl

abgesetzt:

ssh-keygen -t <Schlüsseltyp> -b <Schlüssellänge>

Es müssen Angaben zum Speicherort und der Passphrase gemacht werden.

Wird kein Speicherort angegeben, wird das Schlüsselpaar im Ordner

.ssh des Benutzerverzeichnisses gespeichert.

Es stehen unterschiedliche Schlüsseltypen- und -längen zur Verfügung:

RSA: weit verbreitet, kann mit sehr viel Rechenaufwand evtl. geknackt werden (siehe letzter Absatz dieses Artikels). Als Schlüssellänge sollte 4096 bit gewählt werden.

ecdsa: ist ein neueres Verfahren, das aber kurze Schlüssel nutzt und damit auf Sicherheit verzichtet

ed25519: ist ein neues Verfahren, das auf sog. elliptische Kurven setzt und aktuell als am sichersten gilt. Dieses Verfahren wird empfohlen.

Zur Wahl des Schlüsseltyps gibt es bei goteleport.com eine informative Vergleichstabelle.

WICHITG

Das Schlüsselpaar muss am Client erstellt werden. Sonst ist der private Schlüssel bereits mit der Erstellung auf einem fremden Gerät und damit kompromittiert.

Konfiguration des SSH-Servers

Um die Sicherheit des SSH-Servers weiter zu erhöhen, sollten einige

Einstellungen am Server vorgenommen werden. Dies kann nach erfolgreicher

SSH-Verbindung getan werden. Die Konfigurationsdatei für den SSH-Server

findet sich unter /etc/ssh/sshd_config und kann mit dem

nano-Editor bearbeitet werden.

Folgende Änderungen sollen an der Konfigurationsdatei vorgenommen werden:

Nur spezifischen Usern eine SSH-Verbindung erlauben (neue Zeile am Ende ergänzen):

AllowUsers <username>Anmeldung mit Passwort verbieten und nur per Schlüssel erlauben (vorhandene Zeilen ändern):

PasswordAuthentication no

PubkeyAuthentication yes

KbdInteractiveAuthentication no

UsePAM noStandardport ändern:

#Port 22ändern zuPort <eine Nummer größer 1024>, siehe dazu auch die Liste der Well-Know-PortsRoot-User-Anmeldungen verbieten:

PermitRootLogin noZeit für erfolgreiche Anmeldeversuche auf 30 Sekunden limitieren:

LoginGraceTime 30Leere Passwörter verbieten:

PermitEmptyPasswords noAbmeldung bei Inaktivität:

ClientAliveInterval 300undClientAliveCountMax 0

Nach Änderungen an der Konfiguration eines Programms muss dieses in

der Regel neu gestartet werden, um die neue

Konfiguration zu übernehmen. Dies geschieht für den SSH-Server mit den

Befehlen sudo systemctl daemon-reload und

sudo systemctl restart ssh.service (siehe dazu auch das Callout zu systemd)

Weitere Anpassungen des SSH-Servers sind je nach eigenem Sicherheitsbedürfnis möglich. Z.B. finden sich bei cyberciti.biz einige weitere Möglichkeiten.

Möchte man sich nun per SSH anmelden, müssen die vorgenommenen

Änderungen berücksichtigt werden. V.a. muss die geänderte Portnummer

angegeben werden:

ssh -p <Portnummer> -i <Pfad-zum-privaten-Schlüssel> <user>@<server>

(Achtung: für die Kursumgebung die besonderen Bedingungen im Kurssetup

beachten).

Programme mit systemd Steuern

Programme können unter Debian-basierten Systemen mit dem

Systemd-Dienst gesteuert werden. Voraussetzung dafür ist, dass eine sog.

Unit-Datei vorhanden ist (i.d.R. unter /etc/systemd/system

zu finden). Damit können die Programmge gestartet, gestoppt,

neugestartet und deren Status geprüft werden. Der Systemd-Dienst wird

mit dem Befehl systemctl (kurz für systemcontrol)

bedient:

Programm starten:

sudo systemctl start <Servicename>Programm stoppen:

sudo systemctl stop <Servicename>Programm neustarten

sudo systemctl restart <Servicename>Status überprüfen:

sudo systemctl status <Servicename>Ein Programm zum Autostart hinzufügen:

sudo systemctl daemon-reload && sudo systemctl enable <Servicename>

Fehlerhafte SSH-Anmeldung

Sie wollen sich per SSH mit Ihrem Server verbinden. Sie nutzen dafür

den folgenden Befehl:

ssh linus@eberhard-karl.uni-tuebingen.de -p 2746 -i .ssh\eberhard.key

Die Verbindung schlägt aber mit der Meldung Permission denied (publickey) fehl. Worauf weißt diese Fehlermeldung hin?

Der SSH-Server erfordert ein Schlüsselpaar für die Anmeldung. Zwar wurde der private Schlüssel eberhard.key angegeben. Allerdings wurde er nicht akzeptiert. Dies kann daran liegen, dass auf dem Server der dazugehörige öffentliche Schlüssel nicht hinterlegt ist oder nicht im Account des angegebenen Users (linus) in der Datei authorized_keys gespeichert ist.

Weitere Gründe können sein:

Falsche URL/IP-Adresse: die Anmeldung wird deshalb an einem fremden/falschen Server versucht.

Der User linus existiert nicht auf dem Server

Tip: mit Angabe des Parameters -v erhält man beim Verbingungsversuch mehr Informationen im Falle eine fehlschlags.

das SSH-Protokoll erlaubt den Zugriff auf die Kommandozeile entfernter Computer

zur Erhöhung der Sicherheit empfiehlt sich die Nutzung eines Schlüsselpaares anstatt eines Passworts

zur Reduzierung der Angriffsfläche sollte die Konfiguration des SSH-Servers angepasst werden

ein privater (SSH-)Schlüssel darf niemals das eigene Gerät verlassen

der Aufbau der SSH-Verbindung geschieht wie folgt:

ssh -p <Portnummer> -i <Pfad-zum-privaten-Schlüssel> <user>@<server>

Content from Sicherheit 1: Benutzer und Dateirechte

Zuletzt aktualisiert am 2026-05-12 | Diese Seite bearbeiten

Geschätzte Zeit: 135 Minuten

Übersicht

Fragen

Wer darf was auf meinem System?

Welche Benutzer gibt es unter Linux?

Was sind Dateirechte?

Ziele

Grundlagen der Benutzerverwaltung unter Linux

Dateirechte verstehen und anpassen

Befehle

chmod,chown,adduser,deluserundusermodkennen lernen

Benutzerverwaltung

Benutzerkategorien

Jeder User-Account in Linux besteht aus einem Loginnamen, einer User-ID, ggf. einem beschreibendem Namen und weiteren Metainformationen (z.B. Adresse, Telefonnummer etc). Auf einem üblichen Linux-System gibt es drei Typen von Benutzerkonten:

root: der Root-Account ist der Systemadministrator und hat damit die meisten Rechte im System. Er ist vergleichbar mit dem “Administrator”-Konto in Windows. Die User-ID des root-Accounts ist immer die 0.

Standardaccount: bei der Installation des Betriebssystems (Ubuntu) wurde bereits ein erster Standardaccount erstellt. Standardaccounts sind i.d.R. mit echten Personen in Verbindung zu bringen, haben ein Benutzerverzeichnis unter

/home/und können sich mit einem Passwort am System anmelden. Der erste Standardbenutzer erhält die User-ID 1000. Für alle weiteren wird die ID jeweils um 1 erhöht. Ein Standardaccount kann administrative Rechte erhalten. Wurden ihm diese erteilt, können mit demsudo-Befehl die eigenen Rechte eskaliert werden, d.h. Befehle mit administrativen Rechten ausgeführt werden.Systemaccount: Auf einem frisch installierten Linuxsystem gibt es bereits zahlreiche Systemaccounts. Sie haben i.d.R. User-IDs

<1000. Systemuser sind nicht mit echten Personen zu verbinden und können sich nicht interaktiv am System anmelden. Ein Systemaccount ist im Normalfall für eine explizite Aufgabe vorhanden. Z.B. ist der Account www-data für die Steuerung eines Webservers gedacht.

Sämtliche Benutzeraccounts des Systems können der Datei

/etc/passwd entnommen werden (z.B. öffnen mit

less /etc/passwd).

Möchte man einen neuen Account erstellen, nutzt man den Befehl

adduser. Um z.B. den Account “Linus” hinzuzufügen lautet

der Befehl wie folgt: sudo adduser linus Anschließend kann

das Passwort sowie weitere Metainformationen des Accounts gesetzt

werden. Es wird automatisch ein Homeverzeichnis für den User erstellt.

Möchte man dies nicht, kann der Parameter --no-create-home

dem Befehl angehängt werden.

Gruppen

Neben einzelnen Accounts gibt es auch Gruppen, um mehrere Accounts zusammen zu fassen. Standardmäßig ist jeder Account (System- und Standardaccounts) auch Mitglied in seiner eigenen Gruppe. So ist z.B. der Systemaccount www-data auch Mitglied in der Gruppe www-data. Ein Account hat dabei immer die Rechte, die ihm selbst erteilt wurden plus die Rechte, die den Gruppen erteilt wurden, in welchen er Mitglied ist. Wird ein Recht an einer Stelle verweigert, so hat dies Vorrang vor einer Erlaubnis an anderer Stelle.

Um zu sehen in welchen Gruppen man Mitglied ist, kann der Befehl

id genutzt werden. Der bei der Installation des

Betriebssystems erstellte Standardbenutzer ist bereits in mehreren

Gruppen Mitglied (z.B. der sudo-Gruppe um sudo-Befehle ausführen zu

können). Um alle Gruppen und deren Mitglieder zu sehen kann die Datei

/etc/groups geöffnet werden.

Möchte man einen Account einer Account-Gruppe hinzufügen, nutzt man

den usermod-Befehl (kurz für user modification):

sudo usermod -aG <Gruppenname> <Username>

Möchte man einem Account administrative Rechte erteilen, muss dieser der

sudo-Gruppe hinzugefügt werden:

sudo usermod -aG sudo <Username>

sudo

Mit dem sudo-Befehl können die eigenen Benutzerrechte

eskaliert werden. Das heißt, Befehle mit erhöhten, also administrativen,

Rechten ausgeführt werden. Dazu muss lediglich das

sudo-Kommando vor den Befehl gestellt werden. Um z.B. einen

neuen Account zu erstellen, muss vor den entsprechenden Befehl das

sudo gestellt werden:

sudo adduser <username>

Der sudo-Befehl

Um Befehle mit erhöhten Rechten auszuführen muss das

sudo-Kommando vor den Befehl gestellt werden, z.B.

sudo adduser <username>

Der sudo-Befehl wird auch genutzt, um zwischen Accounts

zu wechseln oder Befehle mit den Rechten eines anderen Accounts

auszuführen. Um z.B. in den Root-Account zu wechseln genügt das

Kommando sudo -i. Anschließend befindet man sich auf der

Kommandozeile des Root-Accounts und alle Befehle werden mit Root-Rechten

ausgeführt. Dementsprechend sollte man hier Vorsicht walten lassen. Um

wieder zur vorhergehenden Kommandozeile des Standardaccounts zu kommen

wird die Root-Befehlszeile mit dem Befehl exit

verlassen.

Möchte man einen Befehl mit den Rechten eines anderen Accounts

ausführen geschieht dies wie folgt:

sudo -u <username> <Befehl> Um z.B. mit den

Rechten des Accounts www-data die Datei startpage.html

zu öffnen lautet der Befehl

sudo -u www-data nano startpage.html

Passwortabfrage bei sudo-Befehl

Um zu verhindern, dass der sudo-Befehl ohne die Kenntnis des

Passworts ausgeführt wird (z.B. wenn ein Angreifer einen Weg ins System

gefunden hat und nun Zugriff auf den Account hat), sollte das System so

konfiguriert werden, dass für den sudo-Befehl immer ein

Passwort verlangt wird.

Standardmäßig ist Ubuntu so konfiguriert, dass Mitglieder der sudo-Gruppe zwar administrative Rechte haben, aber diese immer mit ihrem Passwort bestätigen müssen.

Dieses Verhalten kann aber den eigenen Wünschen angepasst werden,

indem im Verzeichnis /etc/sudoers.d/ mit dem

visudo-Programm eine neue Datei erstellt wird, z.B.:

sudo visudo /etc/sudoers.d/010_<username>-passwd. Um

die Passwortabfrage für einen bestimmten Account zu forcieren, kann

folgende Syntax genutzt werden:

<username> ALL=(ALL) PASSWD: ALLDabei muss <username> durch den eigenen Usernamen

ersetzt werden. Siehe zur sudoers-Datei auch die Diskussion

auf askubuntu und den Artikel bei ubuntuusers.

Benutzerverwaltung

Sie sind mit Ihrem Standardaccount am System angemeldet, dieser hat bereits administrative Rechte. Nun wollen Sie Ihrem System den neuen Account Linus hinzufügen. Dieser Account soll ebenfalls administrative Rechte erhalten. Wie lauten die korrekten Befehle?

adduser linusundusermod -aG linus sudosudo adduser linusundsudo usermod -aG sudo linussudo visudo linusundsudo usermod -aG www-data linus

- Antwort 2 ist die richtige Lösung.

Bei Antwort 1 fehlt das sudo-Kommando vor den

eigentlichen Befehlen und beim usermod-Befehl sind user und Gruppe

vertauscht.

Bei Antwort 3 macht der erste Teil gar keinen Sinn und der zweite ist zwar technisch korrekt, führt aber nicht zum gewollten Ziel.

Dateirechte

Jede Datei des Systems ist einem Besitzer und einer Gruppe zugeordnet. Darüber kann gesteuert werden, wer auf welche Dateien mit welchen Rechten zugreifen darf. Die genauen Rechte werden über den sogenannten mode gesteuert. Der mode gibt für jede Datei an, welche Rechte der Besitzer, die besitzende Gruppe und “andere Accounts” haben. Andere Accounts sind dabei alle anderen Accounts des Systems, auch Gastaccounts oder Systemaccounts.

Mit dem Befehl ls -l <Dateipfad> können die

Inhalte eines Verzeichnisses und deren Berechtigungen angezeigt werden.

Ohne Pfadangabe wird das aktuelle Verzeichnis gewählt. Die Ausgabe des

Befehls ls -l /home/linus könnte z.B. wie folgt

aussehen:

BASH

total 4

drwxrwxr-x 2 linus linus 4096 Aug 21 15:35 Ordner1

-rw-rw-r-- 1 linus linus 15 Aug 21 15:34 testdatei.txtDies ist wie folgt zu verstehen:

drwxrwxr-x = es handelt sich um ein Verzeichnis (d für directory, l für Link, - für Datei)

drwxrwxr-x = der Besitzer hat Lese- Schreib -und Ausführberechtigungen

drwxrwxr-x = die besitzende Gruppe hat Lese- Schreib -und Ausführberechtigungen

drwxrwxr-x = alle anderen haben nur Lese- und Ausführberechtigungen

linus linus = die Datei/das Verzeichnis gehört dem User linus

linus linus = die Datei/das Verzeichnis gehört der Gruppe linus

4096 = Dateigröße in Bytes

Aug 21 15:35 = Änderungszeit

Ordner1 = Verzeichnis-/Dateiname

Der ls-Befehl ist bei Ubuntuusers auch ausführlich erklärt.

Möchte man den Eigentümer einer Datei oder eines Verzeichnisses

ändern, wird der Befehl chown genutzt (kurz für change

ownership):

chown <neuer besitzer>:<neue Grupppe> <Datei/Verzeichnisname>.

Um z.B. die Datei test.txt dem User und der Gruppe

linus zu übertragen lautet der Befehl wie folgt:

sudo chown linus:linus test.txt. Soll ein gesamtes

Verzeichnis übertragen werden, wird der Parameter -R

(rekursiv) genutzt: sudo chown -R linus:linus Ordner1

Möchte man den mode ändern (also die Rechte für Besitzer und

Gruppe), nutzt man den Befehl chmod (kurz für change mode):

sudo chmod <Modus> <Datei/Verzeichnis> Der

Modus setzt sich dabei stets aus drei Angaben zusammen:

-

Angabe für wen etwas geändert wird (Gruppe oder Account)

u= userg= groupoother (=alle anderen)

-

Angabe, ob ein Recht erteilt oder entzogen werden soll

+= Recht erteilen-= Recht entziehen

-

Angabe zum betroffenen Recht.

r= read (Leseberechtigung)w= write (Schreibbrechtigung)e= execute (Ausführen von Dateien oder Verzeichnisinhalt von Ordnern anzeigen lassen)

Eine ausführliche Erklärung zu Dateirechten findet sich wieder bei Ubuntuusers

Beispiel

Die Datei test.txt gehört dem User linus und der

Gruppe www-data. Um nun dem User Lese- Schreib- und

Ausführberechtigung zu erteilen, der Gruppe aber nur Leserechte, lauten

die Befehle wie folgt: sudo chmod u+rwx testdatei.txt für

die Userberechtigung und sudo chmod g+r testdatei.txt für

die Gruppenberechtigung. Möchte man der Gruppe www-data wieder das

Leserecht entziehen, lautet der Befehl wie folgt:

sudo chmod g-r testdatei.txt

Dateiberechtigungen

Sie wollen mit Ihrem Standardaccount (dieser ist Mitglied der

sudo-Gruppe) im Verzeichnis /opt/ den neuen Ordner

webservice erstellen. Der Ordner soll dem User

linus und der Gruppe www-data gehören. Der User soll

volle Rechte haben, die Gruppe soll lesen und ausführen dürfen, alle

anderen sollen keine Rechte erhalten. Wie lauten die korrekten

Befehle?

mkdir /opt/webservicechown linus:www-data /opt/webservicechmod 750

sudo mkdir /opt/webservicesudo chown linus:www-data /opt/webservicesudo chmod u+rwxsudo chmod g+rsudo chmod o-rwx

sudo touch /opt/webservicesudo chmod linus:www-data /opt/webservicesudo chown u+rwxsudo chown g+rsudo chown o-rwx

sudo mkdir /opt/webservicesudo chown linus:www-data /opt/webservicechmod linus:+rwxchmod www-data:+rchmod others:-rwx

- Antwort 2 ist korrekt. Die drei

chmod-Befehle könnten noch durchsudo chmod 750zusammengefasst werden, siehe dazu den Ubuntuusers-Artikel zu Dateirechten

Antwort 1 schlägt fehl, da keine administrativen Rechte genutzt werden

Antwort 3 erstellt eine Datei anstatt eines Verzeichnisses. Außerdem

sind die Befehle chmod und chown

vertauscht.

In Antwort 4 ist der chmod-Befehl fehlerhaft

der root-Account ist der Administrator des Systems

Mitglieder der sudo-Gruppe haben administrative Rechte, welche sie mit dem

sudo-Kommando nutzen könnenDateien und Ordner sind immer einem Benutzer und einer Gruppe zugeordnet. Die Besitzverhältnisse können mit

chowngeändert werden.Dateien und Ordner haben einen mode, welcher die Rechte von Besitzer und besitzender Gruppe steuert, er kann mit

chmodgeändert werden

Content from Sicherheit 2: Firewall und Fail2Ban

Zuletzt aktualisiert am 2026-05-12 | Diese Seite bearbeiten

Geschätzte Zeit: 135 Minuten

Übersicht

Fragen

Wie kommunizieren Computer im Netzwerk?

Wie schütze ich meinen Server im Netzwerk?

Ziele

Grundlagen der Netzwerkkommunikation verstehen

Eine einfache Firewall einrichten

Fehlerhafte Logins mit Fail2Ban überwachen

Netzwerkkommunikation

OSI-Referenz-Modell

Um allgemeine Leitlinien für Hersteller von Hard- und Software zu etablieren, wurde das OSI-Referenz-Modell entwickelt, welches die Kommunikationsabläufe in Computernetzwerken definiert. Gemäß dem Modell läuft ein Datenpaket beim Sender durch sieben Kommunikationsschichten und beim Empfänger wieder durch die selben Schichten, allerdings in umgekehrter Reihenfolge. Jede dieser Schichten hat klar definierte Aufgaben und spezifische Protokolle. Ein Datenpaket wird dabei in einer Schicht verarbeitet, z.B. in der obersten Schicht (Anwendungsschicht) per HTTP abgerufen und dann an die nächste Schicht übergeben. Dort werden weitere Schritte unternommen. Z.B. könnte das jetzt fertig geschnürte HTTP-Paket zu einem HTTPS-Paket verschlüsselt werden. Am untersten Ende (auf der Bitübertragungsschicht) wird schließlich nur noch festgelegt, wie der Strom über die Leitung fließt.

Da auf jeder Schicht beim Sender weitere Informationen zum Datenpaket hinzugefügt werden (z.B. eine Veschlüsselung oder die IP-Adresse des Empfängers) wird das Datenpaket immer größer (sog. Overhead). Beim Empfänger wird das Paket wieder Schritt für Schritt “ausgepackt”.

Eine ausführliche Erklärung zum OSI-Modell inkl. Video findet sich bei Studyflix.

IP-basierte Netzwerke

Um Kommunikationspartner im Netzwerk zu identifizieren, besitzt jedes

Netzwerkfähige Gerät (genauer gesagt: jedes Netzwerinterface) eine

Hardwareadresse: die MAC-Adresse. Die MAC-Adresse ist

auf Schicht 2 des OSI-Modells definiert. Um nun zu definieren, wo sich

diese MAC-Adresse im Netzwerk befindet, werden in Schicht 3 des

OSI-Modells IP-Adressen eingeführt. Mit IP-Adressen

werden zunächst logische Netzwerksegmente definiert. Dabei wird jedes

Netzwerk mit einer IP-Adresse beschrieben. Diese Netzwerkadresse ist der

Startpunkt des Netzwerkes (z.B. 192.168.178.0). Mit der

Subnetzmaske wird die Anzahl an möglichen Adressen

innerhalb dieses Netzwerks festlegt (z.B. 255.255.255.0

oder in Kurzform /24 für ein Netzwerk mit max. 254

Geräten). Das Ende des Netzwerksegments wird durch die

Broadcast-Adresse definiert (z.B.

192.168.178.255). Datenpakete, die an die Broadcast-Adresse

gesendet werden, werden an alle Adressen des Segments weitergeleitet.

Innerhalb des Segments werden einzelne Geräte durch eine IP-Adresse

definiert (z.B. 192.168.178.25). Wandert das Gerät in ein anderes

Netzwerksegment erhält es eine andere IP-Adresse.

Um eine Kommunikation zwischen verschiedenen Netzwerken (z.B. einem Heimnetzwerk mit der Adresse 192.168.178.0 und der Subnetzmaske 255.255.255.0 und dem Internet) zu ermöglichen, wird ein Standardgateway benötigt. Dies ist i.d.R. die IP-Adresse des Routers. An diesen werden alle Pakete geschickt, die keine Adresse im lokalen Netzwerk haben, und werden dann z.B. ins Internet weiter geleitet.

Es werden unterschiedliche Typen von Netzwerken unterschieden: Private Netzwerke und öffentliche Netzwerke. Private Netzwerke sind nicht öffentlich erreichbar und sind durch Router und Firewalls von öffentlichen Netzwerken getrennt. Dadurch können private Netzwerke mit derselben IP-Adresskonfiguration mehrfach existieren, da sie sich gegenseitig nicht “sehen”.

Folgende Adressbereiche für private Netzwerke gibt es:

| Netzadressbereich | Subnetzmaske | Max. Anzahl Geräte | Bedeutung |

|---|---|---|---|

| 10.0.0.0 bis 10.255.255.0 | 255.0.0.0 | 16777216 | Privates Netzwerk |

| 172.16.0.0 bis 172.31.255.255 | 255.240.0.0 | 1048576 | Privates Netzwerk |

| 192.168.0.0 bis 192.168.255.255 | 255.255.0.0 | 256 | Privates Netzwerk |

| 169.254.0.0 bis 169.254.255.255 | 255.255.0.0 | 65536 | Link Local/APIPA = Standardbereich, wenn automatische Adresszuweisung fehlschlägt |

| 127.0.0.1 bis 127.255.255.254 | 255.0.0.0 | 16777216 | Loopback-Adresse für Kommunikation innerhalb eines Geräts |

IP-Adressen

Werden zentrale Dienste betrieben oder genutzt, muss man sich auch mit dem zugrunde liegenden Netzwerk befassen. Informieren Sie sich deshalb über Ihr Netzwerk:

Welche IP-Adresse hat Ihr Computer?

Wie lautet die Subnetzmaske?

Welche IP-Adressen können Geräte in Ihrem Netzwerk erhalten?

Welche IP-Adressen hat Ihr Router?

Typische Adressen könnten wie folgt lauten:

IP-Adresse: 192.168.178.25

Subnetzmaske: 255.255.255.0

Daraus folgt der Adressbereich 192.168.178.1 bis 192.168.178.254 (die erste Adresse ist als Netzwerkadresse und die letzte als sogenannte Broadcastadresse reserviert und nicht für Geräte verfügbar).

Router geben sich meistens selbst die erste Adresse im Netzwerk, in diesem Beispiel also 192.168.178.1. Zusätzlich erhält der Router auch eine IP-Adresse im Netzwerk des Internetanbieters. Erst dadurch, dass der Router in beiden Netzwerken eine Adresse hat, kann er auch Datenpakete zwischen den Netzwerken verteilen.

Ports

Ist ein Datenpaket innerhalb eines IP-Netzwerks an einem Host (also einem Gerät) angekommen, muss noch geklärt werden, wohin das Paket innerhalb des Geräts gehört. Da auf einem Computer viele Programme gleichzeitig aktiv sind, muss entschieden werden, für welches der Programme ein Paket gedacht ist. Dazu werden Ports genutzt. Ein Programm, welches Daten aus dem Netzwerk empfangen soll, nutzt dabei einen festgelegten Port. Kommt am Gerät ein Datenpaket an, das mit dem Port des Programms adressiert ist, wird das Paket an das entsprechende Programm geleitet und von diesem verarbeitet. Zum Beispiel “lauscht” der SSH-Server standardmäßig auf Port 22 für eingehenden Datenverkehr. Wir haben diesen Port in Lektion 3 manuell abgeändert.

Einige Ports sind fest für bestimmte Programme definiert und sollten nicht von anderen Programmen oder manuell belegt werden. Andere Ports können jedoch von Systemadministratoren frei genutzt werden. Die Portnummern reichen von 0 bis 65.535. Eine Auflistung aller Ports und deren Verwendung findet sich bei Wikipedia.

Ein Port kann auf einem Gerät offen oder geschlossen sein, z.B. kann eine Firewall die Kommunikation über einen Port blockieren. Außerdem muss ein Prozess hinter einem Port “hören”, damit eine Kommunikation aufgebaut werden kann.

Um zu sehen, welche Prozesse auf welchen Ports hören, kann der Befehl

netstat -tulp ausgeführt werden. Vorher muss dafür das

Paket net-tools installiert werden.

Firewall

Um Kommunikation in einem Netzwerk zu kontrollieren, werden Firewalls eingesetzt. Zu unterscheiden ist hierbei zwischen Hardware- und Desktopfirewalls. Eine Hardware- oder auch externe Firewall ist in der Regel ein dediziertes Gerät, welches primär unterschiedliche Netzwerke trennt. In einfacher Form kommt ein Heimrouter wie eine Fritz.Box dieser Aufgabe nach. Denn der Router trennt mit seiner Firewall das Internet vom Heimnetz und verhindert dadurch, dass aus dem Internet auf Geräte im Heimnetzwerk zugegriffen werden kann. In komplexeren Netzwerken (z.B. in Unternehmen) werden professionellere Geräte eingesetzt, welche mehr Funktionalität und Leistung bieten.

Eine Desktop- oder auch personal firewall dagegen ist meistens in Form von Software auf einem Gerät installiert. Unter Microsoft Windows wäre dies die Windows Defender Firewall, die den PC vor Zugriffen aus einem angeschlossenen Netzwerk schützt. Unter Linux kann dafür die uncomplicated firewall (kurz: UFW) genutzt werden.

Funktionsweise

Vereinfacht kann die Funktionsweise einer Firewall in mehrere Bereiche unterteilt werden. Dabei unterstützt nicht jede Firewall alle dieser Funktionen.

Paketfilter: filtert nach Adressen der Datenpakete (IP-Adressen, MAC-Adressen, Ports, URLs) -> Wer darf wohin?

Content/Proxy/Deep Packet-Filter: filtert nach dem Inhalt und kann so spezifische Inhalte blockieren. Z.B. kann Malware erkannt werden -> Was darf unterwegs sein?

Kombinierte Filter: durch die Kombination verschiedener Kriterien wie Uhrzeit, Herkunft der Anfrage, Ziel der Anfrage oder die Häufigkeit der Anfrage kann Datenverkehr blockiert oder erlaubt werden -> wie darf etwas unterwegs sein?

Geoblocking: häufig bieten Firewalls auch die Möglichkeit, Anfragen aus bestimmten Ländern zu blockieren. Allerdings können Angreifer solche Blockaden umgehen, indem sie Ihre Anfragen über Server in nicht blockierten Ländern leiten. Dennoch kann ein Geoblocking bisweilen massenhafte und wenig zielgerichtete Angriffsversuche unterbinden. -> Woher darf etwas kommen?

Ist ein Filterkriterium erfüllt, wird eine Aktion ausgeführt. Wird ein Paket verworfen (drop oder deny), wird es schlicht nicht weitergeleitet. Der Absender erhält darüber keine Auskunft. Wird ein Paket zurückgewiesen (deny oder reject) wird das Paket ebenfalls nicht weitergeleitet, der Absender wird allerdings direkt über den Kommunikationsabbruch informiert. Wird das Paket akzeptiert wird es an die Zieladresse weitergeleitet.

Allgemeine Tips zur Firewall

die Firewall muss immer aktiv sein

standardmäßig sollen eingehende Verbindungen blockiert werden

eingehende Verbindungen sollen nur für einzelne Ports und Anwendungen geöffnet werden

Sicherheit durch alternative Ports (wie beim SSH-Server) bringt nur ein wenig (siehe dazu den Wikipedia-Artikel zu Security through obscurity)

ein im Netzwerk exponiertes Programm (inkl. dem Betriebssystem) muss immer aktuell gehalten werden

die Kommunikation soll über verschlüsselte Protokolle stattfinden (TLS, SSH, HTTPS…)

für noch mehr Sicherheit kann gesorgt werden, wenn auch der ausgehende Datenverkehr gefiltert wird und nur explizit notwendige Anfragen, z.B. für Softwareupdates, zugelassen werden aber Anfragen ins lokale Netzwerk unterbunden werden. Siehe dazu ein Beispiel mit der IP-Tables-Firewall

Für Fortgeschrittene: mittels Port-knocking kann die Firewall nur kurzzeitig und explizit geöffnet werden und nach dem Ende der Kommunikation wieder geschlossen werden. Siehe dazu z.B. dieses Tutorial im Netz.

Umsetzung auf dem Server

(Installation:

sudo apt-get install ufw(ist standardmäßig bereits installiert))Regel hinzufügen:

sudo ufw allow <Portnummer>odersudo ufw deny <Portnummer>Standardregel für eingehenden Verkehr:

sudo ufw default deny incomingStandardregel für ausgehenden Verkehr:

sudo ufw default allow outgoingZugriff auf SSH-Port nur aus einem lokalen Netzwerk zulassen (Netzwerkadresse anpassen!):

sudo ufw allow from 192.168.178.0/24 to any port 22Firewall aktivieren:

sudo ufw enableStatus anzeigen lassen:

sudo ufw statusStatus mit Nummer anzeigen lassen:

sudo ufw status numberedRegel löschen:

sudo ufw delete <Nummer-der-Regel>

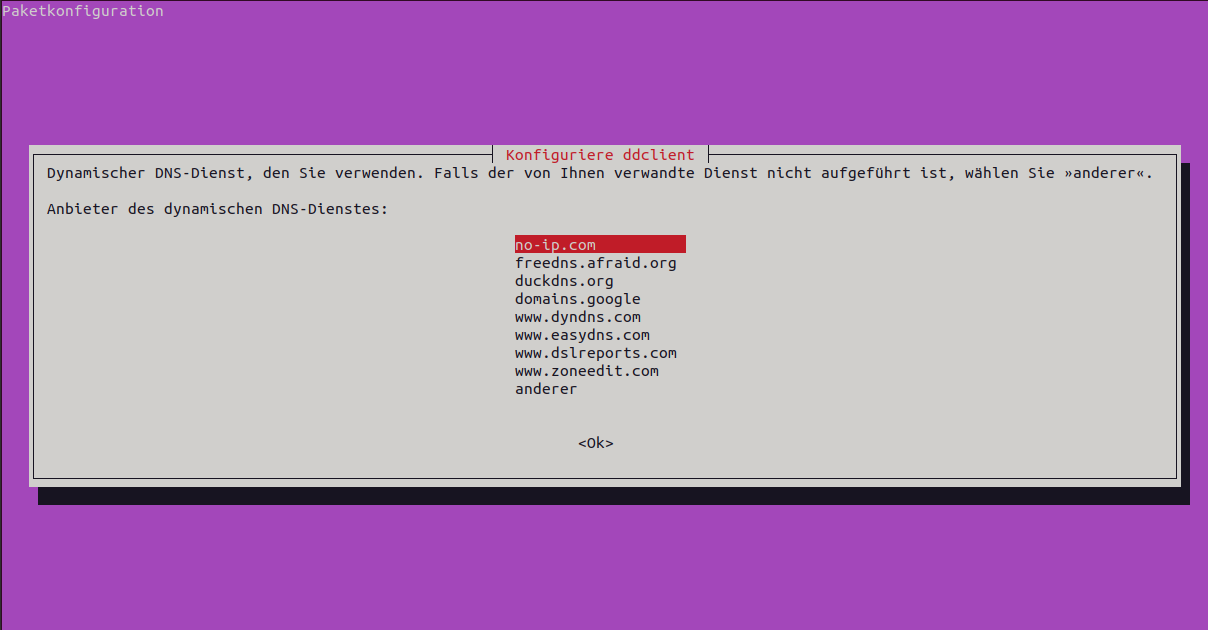

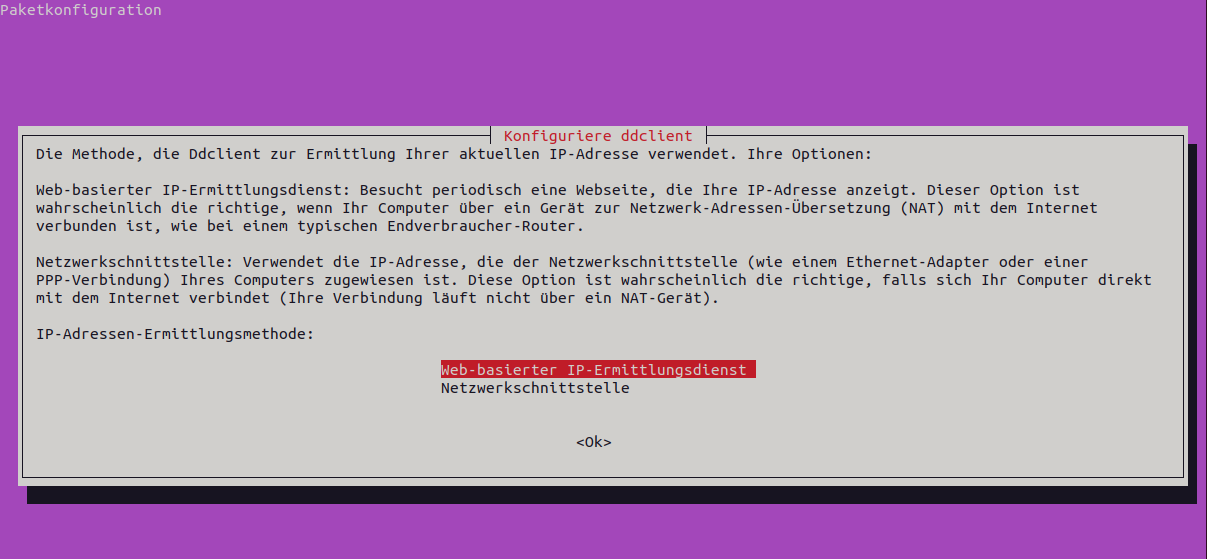

Im Netz finden sich zahlreiche Anleitungen für die UFW. Empfehlenswert sind die Anleitungen von DigitalOcean und PiMyLifeUp

Fail2Ban

Nachdem in der (uncomplicated) Firewall ein Port geöffnet wurde, kann die Kommunikation mit dem hinter dem Port wartenden Dienst stattfinden. Jedoch ist es empfehlenswert diese Kommunikation weiterhin im Blick zu behalten.

Für einfache Szenarien kann das Programm Fail2Ban genutzt werden, um unerwünschte Eindringversuche zu erkennen und zu blockieren. Ein typischer Angriffsversuch, welcher mit Fail2Ban abgefangen werden kann, ist eine Brute-Force-Attacke, bei welcher durch massenhafte Anfragen versucht wird, Benutzername und Passwort zu erraten. Die dabei unweigerlich zahlreich auftretenden Fehlversuche werden in einer Protokolldatei im System notiert. Durch die Überwachung dieser Protokolldatei (auch als Logdatei bezeichnet) kann Fail2Ban die Absenderadresse der massenhaften Loginversuche erkennen und blockieren, indem die Adresse der Firewall als zu blockierende Adresse mitgeteilt wird.

Zu Fail2Ban gibt es im Netz verschiedne Anleitungen. Z.B. im offiziellen Raspberry Pi Handbuch oder wieder bei PiMyLifeUp.

Umsetzung auf dem Ubuntu-Server:

Installation:

sudo apt-get install fail2banAktivierung:

sudo cp /etc/fail2ban/jail.conf /etc/fail2ban/jail.local-

Beispielkonfiguration der Standardparameter mittels

sudo nano /etc/fail2ban/jail.localStandard Sperrzeit:

bantime = 20mStandardanzahl möglicher Fehlversuche:

maxretry = 3Standardzeit für “maxretry”:

findtime = 10m

-

Zu überwachende Services/Ports werden am Ende der Datei

/etc/fail2ban/jail.localmit[<Name>]definiert und mit Detaileinstellungen konfiguriert:Aktivierung:

enabled = trueAngabe des Ports:

port = <Portnummer des ServicesAngabe der zu überwachenden Logdatei:

logpath = <Pfad zur Logdatei>Angabe des Filters, mit dem die Logdatei geprüft wird:

filter = <Name der Datei im Verzeichnis /etc/fail2ban/filter.d/>

Beispiel für den SSH-Server:

BASH

#Standardeinstellungen vornehmen

bantime = 60m

findtime = 15m

maxretry = 3

# Im Bereich [sshd]

[sshd]

enabeld = true

port = <ssh-port>

logpath = %(sshd_log)s

backend = systemd

filter = sshdNetzwerksicherheit

Sie sollen für Ihre Arbeitsgruppe einen kleinen Server mit diversen Diensten betreiben (z.B. einen Cloudserver). Wie gewährleisten Sie die Netzwerksicherheit, um unbefugten Zugriff auf den Server zu verhindern?

Einige wichtige und grundlegende Maßnahmen können sein:

Firewall auf dem Server aktivieren

Eingehende Verbindungen blockieren

nur einzelne Ports für die notwendigen Dienste und nur innerhalb des lokalen Netzwerkes freigeben

Mit Fail2Ban oder vergleichbaren Tools fehlerhafte Loginversuche überwachen

Regelmäßige Wartung: Sowohl der Server als auch alle anderen Netzwerkkomponenten (Router, Switche etc) müssen stets mit aktueller Soft- und oder Firmware ausgestattet werden.

der SSH-Serverdienst sollte entsprechend Lektion 3 konfiguriert werden

Noch mehr Sicherheit erhalten Sie durch eine Netzwerksegmentierung: sie trennen das Netzwerk in mehrere logische Bereiche auf, zwischen denen ein Router mit Firewall vermittelt.

Schützen Sie den Server(raum) auch physikalische vor unbefugtem Zugriff: die Hardware sollte nur für berechtigte Personen zugänglich sein.

Computer kommunizieren im Netzwerk nach Standards, das OSI-Schichten-Modell stellt einen Leitrahmen für diese Standards dar

Versendete Daten im Netzwerk haben immer einen Absender- und einen Empfänger (in Form von MAC-Adresse, Netzwerk-ID, IP-Adresse und Port)

Mit einer Firewall können Ports geöffnet und geschlossen werden

Mit Fail2Ban können fehlerhafte Loginversuche festgestellt und blockiert werden

Content from Grundlegendes zu Docker

Zuletzt aktualisiert am 2026-05-12 | Diese Seite bearbeiten

Geschätzte Zeit: 135 Minuten

Übersicht

Fragen

Was ist Virtualisierung

Was sind Container

Wie nutze ich Docker

Ziele

Theoretische Grundlagen von Virtualisierungstechnologien

Vergleich von Containern und virtuellen Maschinen

Installation und Nutzung der Docker Engine

Virtualisierungsstrategien:

Bereitstellung von Serverdiensten

Die traditionelle Bereitstellung von Serverdiensten erfolgt durch die Installation eines Betriebssystems direkt auf der Hardware, gefolgt von der Installation der benötigten Anwendungen. Diese Methode hat jedoch einige Nachteile: Es erfolgt keine Trennung der Anwendungen und Prozesse, wodurch bei Kompromittierung einer Anwendung das gesamte System betroffen ist. Zudem werden die Hardwareressourcen ineffizient genutzt, was zu höheren Kosten bei Hardwarebeschaffung und Stromverbrauch führt und damit auch den Prinzipien der Green-IT widerspricht.

Heute wird daher häufiger auf Virtualisierung gesetzt. Virtualisierung bedeutet, dass Hardwareressourcen wie Prozessor, Arbeitsspeicher, Festplattenspeicher, Netzwerk oder Grafikkarte durch spezielle Virtualisierungsprogramme unterteilt werden und virtuellen Maschinen zugeteilt werden. Dies führt zu einer effizienteren Nutzung der Hardware und erhöht die Sicherheit durch die Trennung der Anwendungen.

Dabei wird das System mit der physischen Hardware, auf welchem die Virtualisierungsprogramme laufen, als Host oder Wirt bezeichnet. Als Gast wird die virtualisierte Umgebung bezeichnet.

Unterschiedliche Typen der Virtualisierung:

Typ-1: Hierbei handelt es sich um spezielle Betriebssysteme, die primär der Virtualisierung dienen. Solche Systeme werden auch als Hypervisor bezeichnet. Bei diesen Systemen werden der virtuellen Maschine die Hardwareressourcen direkt zugeteilt. Diese Methode ist performanter als Typ-2 und wird hauptsächlich für die Servervirtualisierung in Rechenzentren oder Unternehmensnetzwerken verwendet.

Typ-2: Bei dieser Methode läuft ein normales Desktop-Betriebssystem (Windows, Linux, MacOS) auf der physischen Hardware. Innerhalb dieses Systems wird die Virtualisierungssoftware installiert und diese Software verwaltet die Zuteilung der Hardwareressourcen auf die virtuellen Maschinen. Diese Methode wird häufig für lokale Tests, in der Entwicklung oder für die parallele Nutzung von (unterschiedlichen) Betriebssystemen verwendet. Sie ist einfacher in der Handhabung, bietet aber weniger Leistung und Funktion.

Containervirtualisierung: Hierbei haben die virtualisierten Anwendungen direkten Zugriff auf die Hardware und den Kernel des Betriebssystems. Anstatt die Hardware zu virtualisieren wird nur die Software virtualisiert. Dabei wird nicht das gesamte Betriebssystem virtualisiert, sondern nur die benötigte Anwendung und deren Abhängigkeiten. Man spricht hier auch von Microservices. Dies führt zu einer geringeren Trennung der Anwendungen und reduziert damit die sicherheitstechnischen Vorteile einer virtuellen Maschine. Die Containervirtualisierung bietet jedoch eine höhere Performance, da sie “näher” an der Hardware des Hosts arbeitet. Containervirtualisierung wird häufig für die Bereitstellung von Anwendungen in komplexen Serverumgebungen oder als Entwicklungsumgebung verwendet. Ein Beispiel für Containervirtualisierung ist Docker: Dockercontainer haben ihr eigenes Dateisystem mit eigenen Benutzerrechten, nutzen jedoch direkt den Kernel des Hosts.

Weiterführende Quellen

- Virtualisierung allgemein (IBM 1)

- Container vs. virtuelle Maschinen (IBM 2)

- Containervirtualisierung (IBM 3)

Virtualisierungstypen

Recherchieren Sie zu den folgenden Produkten und ordnen Sie diese den entsprechenden Virtualisierungstechnologien zu:

- Proxmox

- VirtualBox

- Docker

- Kubernetes

- Hyper-V

Proxmox: Typ-1-Virtualisierung basierend auf dem Betriebssystem Debian und aufbauend auf der KVM-Technologie.

VirtualBox: Typ-2-Virtualisierung. VirtualBox ist eine Open-Source-Virtualisierungssoftware, die auf einem bestehenden Betriebssystem läuft und es ermöglicht, mehrere Gastbetriebssysteme zu betreiben.

Docker: Containervirtualisierung. Docker ist eine Plattform, die es ermöglicht, Anwendungen in Container zu verpacken, die unabhängig von der zugrunde liegenden Infrastruktur ausgeführt werden können.

Kubernetes: Containervirtualisierung. Kubernetes ist ein von Google entwickeltes Open-Source-System zur Automatisierung der Bereitstellung, Skalierung und Verwaltung von containerisierten Anwendungen.

Hyper-V: Typ-1-Virtualisierung. Hyper-V ist eine Virtualisierungsplattform von Microsoft, die es ermöglicht, mehrere Betriebssysteme auf einem einzigen physischen Server zu betreiben.

Docker Engine

Docker ist eine bekannte und weit verbreitete Open-Source-Software für Containervirtualisierung. Die Docker Engine läuft als Hintergrundprozess auf dem Betriebssystem (Daemon), um die Container zu steuern. Dieser Prozess muss aktiv sein, um Docker nutzen zu können.

Komponenten

Einige wichtige Komponenten der Docker Engine sind die folgenden:

Images

Images bilden die Grundlage eines Containers. Ein Image enthält alle notwendigen Dateien und Abhängigkeiten, die benötigt werden, um eine Anwendung auszuführen. Dies umfasst das Betriebssystem, die Anwendungssoftware, Bibliotheken und Konfigurationsdateien. Images werden über Registries wie Docker Hub oder GitHub zur Verfügung gestellt, wo sie heruntergeladen und verwendet werden können.

Container

Ein Container ist eine aktive Instanz, die aus einem Image erstellt wird. Aus einem einzigen Image können mehrere Container erstellt werden. Jeder Container ist eine isolierte Umgebung, die unabhängig von anderen Containern läuft. Dies ermöglicht es, mehrere Anwendungen auf demselben Host-System auszuführen, ohne dass sie sich gegenseitig beeinflussen.

Volumes

Volumes sind persistente Datenspeicher, die verwendet werden, um Daten dauerhaft zu speichern. Im Gegensatz zu den Dateien innerhalb eines Containers, die bei der Beendigung des Containers verloren gehen, bleiben die Daten in einem Volume erhalten. Volumes sind besonders nützlich für Anwendungen, die Daten über mehrere Container-Instanzen hinweg speichern müssen, wie z.B. Datenbanken oder Log-Dateien.

Installation

Die Installation der Docker Engine auf Ubuntu kann mittels einer von Docker zur Verfügung gestellten Fremdquelle erfolgen. Die Schritte sind dem offiziellen Handbuch zu entnehmen. Nutzen Sie die Installationsvariante mittels apt-Repository und installieren Sie die aktuellste Version (“Latest”).

Überprüfen Sie anschließend die Installation mit dem Befehl

docker -v. Dieser Befehl sollte Ihnen die aktuelle

Versionsnummer von Docker zurück liefern.

Konfiguration

Nach der Installation der Docker Engine sind einige Konfigurationsschritte notwendig, um die Docker-Umgebung optimal zu nutzen.

Der Docker Daemon kann mit der Datei

/etc/docker/daemon.json angepasst werden. Diese muss

manuell erstellt werden

(sudo nano /etc/docker/daemon.json). Die

Konfigurationsoptionen für den Docker Daemon werden in dieser Datei im

JSON-Format eingetragen. Eine wichtige Konfiguration ist die

Logrotation, die sicherstellt, dass die Log-Dateien nicht unbegrenzt

wachsen.

Logrotation

Um die Logrotation zu konfigurieren, fügen Sie die die folgenden

Zeilen der daemon.json-Datei hinzu.

Weitere Informationen zur Logrotation finden Sie in der offiziellen Dokumentation: Docker Logging Drivers.

Autostart einrichten

Um sicherzustellen, dass der Docker-Dienst beim Systemstart automatisch gestartet wird, müssen Sie den Autostart einrichten. Dies erfoglt unter Ubuntu mit Systemd:

Weitere Informationen dazu finden Sie in der Dokumentation.

Die Qual der Wahl

Sie haben den Auftrag erhalten, an Ihrem Institut für eine kleine Arbeitsgruppe eine Website und eine Webapplikation zum Dateiaustausch (“Cloud”) zu betreiben. Dazu wird Ihnen ein kleiner Server mit Ubuntu-Betriebssystem zur Verfügung gestellt. Ihr Institut hat mehrere Arbeitsgruppen, die bislang Ihre Daten nur auf lokalen Festplatten speichern.

Welche Installationsvariante wählen Sie?

Ich installiere einen Webserver in Ubuntu (“bare metal”). Dieser stellt sowohl die Website als auch auf einer zweiten Internetseite die Webapplikation zum Datenaustausch bereit.